머신 러닝의 목적

실제 데이터를 바탕으로 다른 입력밧을 넣었을때 발생할 아웃풋을 예측

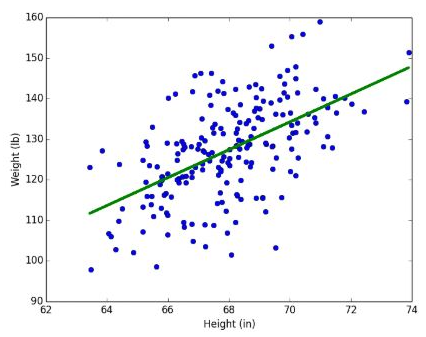

이때 가장 직관적이고 간단하게 나타낼수 있는 모델은 선(line)이다선형회귀(linear regression) 분석

데이터를 놓고 가장 잘 설명할수 있는 선을 찾는 분석 방법최적의 기울기를 찾는 방법 > 근사치

최적의 선으로부터 식을 유추 할 수 있다

y = mx + b

y 정답, Target, Label > 예측치 > 종속변수

x 특징 > 독립변수

m 기울기, 가중치

b 절편, 바이어스

위 그래프에서 키 height와 몸무게 weight는 반드시 관계가 존재해야 한다

인과관계가 존재해야 한다

선형회귀에서 발생하는 오차, 손실 Loss

선과 실제데이터와늬 약간의 차이가 발생하는 오차

>> 손실(Loss)

양수 음수에 관계없이 동일하게 반영되도록 모든 손실에 제곱

손실을 구하는 평균 제곱 오차 mean squared error

MSE

절댓값으로 평균을 구하는 평균 절대 오차 mean absolute error

MAE

선형회귀 모델의 목표

모든 데이터로부터 오차의 평균을 최소화하는 최적의 기울기와 절편을 찾는 것

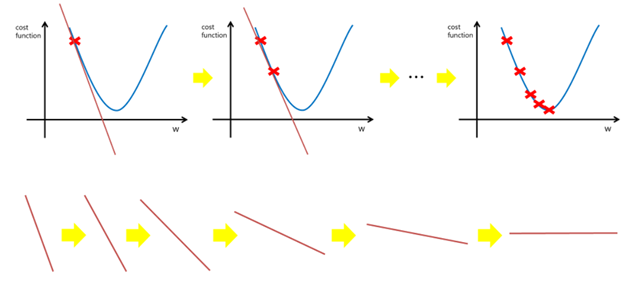

경사하강법 Gradient Descent

GD

파라미터를 임의로 정한 다음에 조금씩 변화시켜가며 손실을 점점 줄여가는 방법으로 최적의 파라미터를 찾아간다

> 기울기가 제로에 수렵할때 까지

그래프의 가장 아래가 loss율이 가장 낮다 수렴 (Convergence)

파라미터를 계속 조정 하다보면 어느정도 최적의 값으로 수렴하게 된다

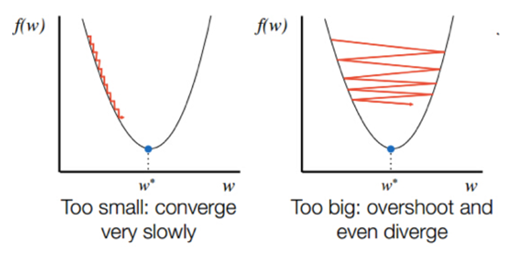

학습률 (Learning Rate)

하이퍼 파라미터

학습률을 크게 설정하면 최적의 값을 제대로 찾지 못함

학습률을 작게 설정하면 최적의 값으로 수렴할 때까지 시간이 오래 걸림모델을 학습시킬 때는 최적의 학습률을 찾는 게 중요

'Colab > 머신러닝' 카테고리의 다른 글

| 06. K-최근접 이웃 회귀 K-NN Regression (0) | 2023.03.06 |

|---|---|

| 05. 로지스틱 회귀분석 Logistic Regression (0) | 2023.03.03 |

| 04. 선형회귀(linear regression) - 학습, 테스트 (0) | 2023.03.02 |

| 03. 선형회귀(linear regression) (0) | 2023.02.28 |

| 01. 기초 이론 (0) | 2023.02.27 |